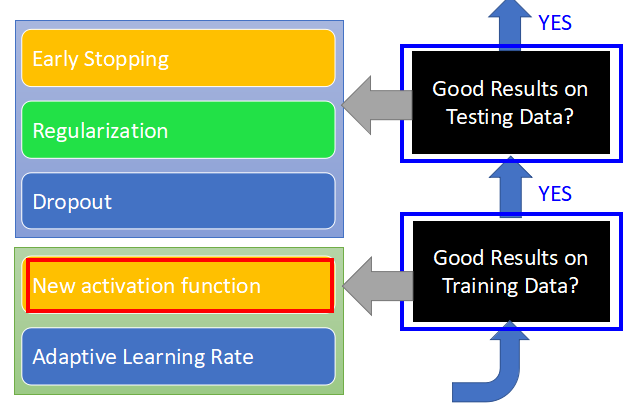

当我们训练网络的时候,通常会出现如下两种情况:

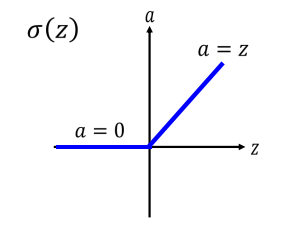

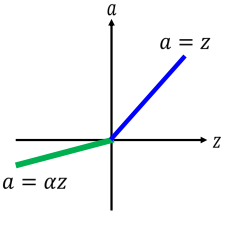

a=z。a=αz,其中α 也可以根据gradient descent学习出来,这样激活函数就变得更加合理了,可以在一定程度上减少训练时间。函数图像如下:

Adagrad的方法,就是将每个参数的学习率除以其先前导数的均方根当作步长,在深度神经网络中,要介绍一种与Adagrad类似的学习率调整方法:RMSProp。RMSProp方法的权值更新公式如下:

α使得下一次的权值调整是受当前梯度倒数gt的影响都一些还是受前面的调整多一些。如果α接近0,则受当前梯度倒数gt影响多一些。α的值还可以通过gradient descen的方法学习出来。惯性,使迭代到达局部最优时,还有有一个动量继续向前,直到到达全局最优呢?Momentum方法:使移动的方向不仅基于当前求导的方向,还要参考上一次移动的方向。参数的更新过程如下:

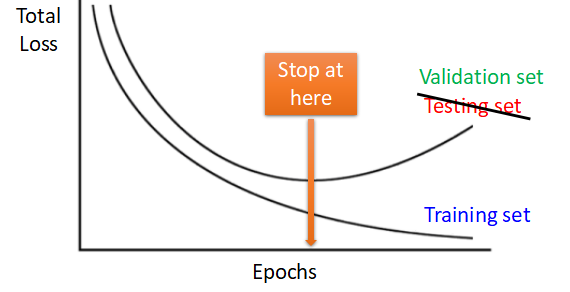

RMSProp + Momentum称为Adam。Training set的performance就越好,但是用训练时间很长得到的参数作用于Testing set时,有可能并不会得到预期中的好结果,反而提前结束训练得到的参数作用于Testing set能得到相对满意的结果。

Training set分出一部分数据用来做Validation set,当获得的参数在Validation set取得好结果的时候,就停止训练,再将参数作用于Testing set。

dropout rate为50%,如果通过训练得到的权值为w=1,则最后令w=0.5作用于Testing set。